- 01 二进制:不了解计算机的源头,你学什么编程.md

- 02 余数:原来取余操作本身就是个哈希函数.md

- 03 迭代法:不用编程语言的自带函数,你会如何计算平方根?.md

- 04 数学归纳法:如何用数学归纳提升代码的运行效率?.md

- 05 递归(上):泛化数学归纳,如何将复杂问题简单化?.md

- 06 递归(下):分而治之,从归并排序到MapReduce.md

- 07 排列:如何让计算机学会“田忌赛马”?.md

- 08 组合:如何让计算机安排世界杯的赛程?.md

- 09 动态规划(上):如何实现基于编辑距离的查询推荐?.md

- 10 动态规划(下):如何求得状态转移方程并进行编程实现?.md

- 11 树的深度优先搜索(上):如何才能高效率地查字典?.md

- 12 树的深度优先搜索(下):如何才能高效率地查字典?.md

- 13 树的广度优先搜索(上):人际关系的六度理论是真的吗?.md

- 14 树的广度优先搜索(下):为什么双向广度优先搜索的效率更高?.md

- 15 从树到图:如何让计算机学会看地图?.md

- 16 时间和空间复杂度(上):优化性能是否只是“纸上谈兵”?.md

- 17 时间和空间复杂度(下):如何使用六个法则进行复杂度分析?.md

- 18 总结课:数据结构、编程语句和基础算法体现了哪些数学思想?.md

- 19 概率和统计:编程为什么需要概率和统计?.md

- 20 概率基础(上):一篇文章帮你理解随机变量、概率分布和期望值.md

- 21 概率基础(下):联合概率、条件概率和贝叶斯法则,这些概率公式究竟能做什么?.md

- 22 朴素贝叶斯:如何让计算机学会自动分类?.md

- 23 文本分类:如何区分特定类型的新闻?.md

- 24 语言模型:如何使用链式法则和马尔科夫假设简化概率模型?.md

- 25 马尔科夫模型:从PageRank到语音识别,背后是什么模型在支撑?.md

- 26 信息熵:如何通过几个问题,测出你对应的武侠人物?.md

- 27 决策树:信息增益、增益比率和基尼指数的运用.md

- 28 熵、信息增益和卡方:如何寻找关键特征?.md

- 29 归一化和标准化:各种特征如何综合才是最合理的?.md

- 30 统计意义(上):如何通过显著性检验,判断你的A_B测试结果是不是巧合?.md

- 31 统计意义(下):如何通过显著性检验,判断你的A_B测试结果是不是巧合?.md

- 32 概率统计篇答疑和总结:为什么会有欠拟合和过拟合?.md

- 33 线性代数:线性代数到底都讲了些什么?.md

- 34 向量空间模型:如何让计算机理解现实事物之间的关系?.md

- 35 文本检索:如何让计算机处理自然语言?.md

- 36 文本聚类:如何过滤冗余的新闻?.md

- 37 矩阵(上):如何使用矩阵操作进行PageRank计算?.md

- 38 矩阵(下):如何使用矩阵操作进行协同过滤推荐?.md

- 39 线性回归(上):如何使用高斯消元求解线性方程组?.md

- 40 线性回归(中):如何使用最小二乘法进行直线拟合?.md

- 41 线性回归(下):如何使用最小二乘法进行效果验证?.md

- 42 PCA主成分分析(上):如何利用协方差矩阵来降维?.md

- 43 PCA主成分分析(下):为什么要计算协方差矩阵的特征值和特征向量?.md

- 44 奇异值分解:如何挖掘潜在的语义关系?.md

- 45 线性代数篇答疑和总结:矩阵乘法的几何意义是什么?.md

- 46 缓存系统:如何通过哈希表和队列实现高效访问?.md

- 47 搜索引擎(上):如何通过倒排索引和向量空间模型,打造一个简单的搜索引擎?.md

- 48 搜索引擎(下):如何通过查询的分类,让电商平台的搜索结果更相关?.md

- 49 推荐系统(上):如何实现基于相似度的协同过滤?.md

- 50 推荐系统(下):如何通过SVD分析用户和物品的矩阵?.md

- 51 综合应用篇答疑和总结:如何进行个性化用户画像的设计?.md

- 导读:程序员应该怎么学数学?.md

- 开篇词 作为程序员,为什么你应该学好数学?.md

- 数学专栏课外加餐(一) 我们为什么需要反码和补码?.md

- 数学专栏课外加餐(三):程序员需要读哪些数学书?.md

- 数学专栏课外加餐(二) 位操作的三个应用实例.md

- 结束语 从数学到编程,本身就是一个很长的链条.md

- 捐赠

41 线性回归(下):如何使用最小二乘法进行效果验证?

你好,我是黄申。

上一节我们已经解释了最小二乘法的核心思想和具体推导过程。今天我们就用实际的数据操练一下,这样你的印象就会更加深刻。我会使用几个具体的例子,演示一下如何使用最小二乘法的结论,通过观测到的自变量和因变量值,来推算系数,并使用这个系数来进行新的预测。

基于最小二乘法的求解

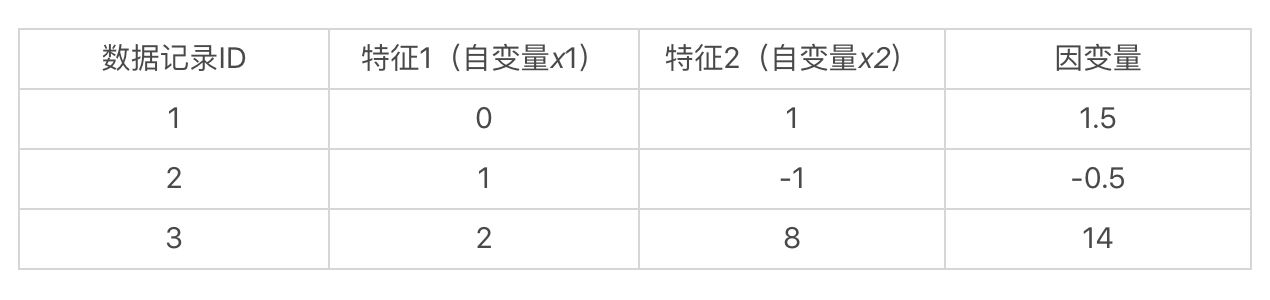

假想我们手头上有一个数据集,里面有3条数据记录。每条数据记录有2维特征,也就是2个自变量,和1个因变量。

如果我们假设这些自变量和因变量都是线性的关系,那么我们就可以使用如下这种线性方程,来表示数据集中的样本:

\(b\_1·0+b\_2·1=1.5\)- \(b\_1·1-b\_2·1=-0.5\)- \(b\_1·2+b\_2·8=14\)

也就是说,我们通过观察数据已知了自变量\(x\_1\)、\(x\_2\)和因变量\(y\)的值,而要求解的是\(b\_1\)和\(b\_2\)这两个系数。如果我们能求出\(b\_1\)和\(b\_2\),那么在处理新数据的时候,就能根据新的自变量\(x\_1\)和\(x\_2\)的取值,来预测\(y\)的值。

可是我们说过,由实际项目中的数据集所构成的这类方程组,在绝大多数情况下,都没有精确解。所以这个时候我们没法使用之前介绍的高斯消元法,而是要考虑最小二乘法。根据上一节的结论,我们知道对于系数矩阵\(B\),有:

\(B=(X’X)^{-1}X’Y\)

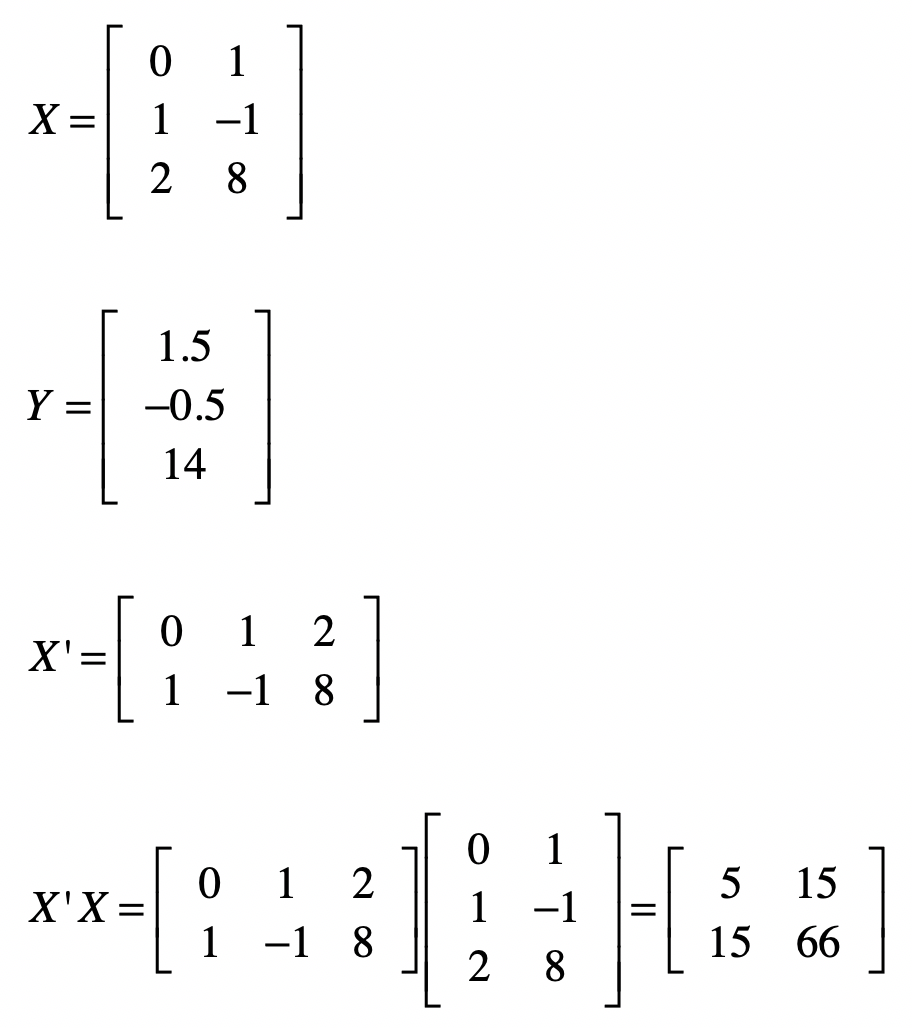

既然有了这个公式,要求\(B\)就不难了,让我们从最基本的几个矩阵开始。

矩阵\((X’X)^{-1}\)的求解稍微繁琐一点。逆矩阵的求法我还没讲解过,之前我们说过线性方程组之中,高斯消元和回代的过程,就是把系数矩阵变为单位矩阵的过程。我们可以利用这点,来求解\(X^{-1}\)。我们把原始的系数矩阵\(X\)列在左边,然后把单位矩阵列在右边,像\(\[X | I\]\)这种形式,其中\(I\)表示单位矩阵。

然后我们对左侧的矩阵进行高斯消元和回代,把左边矩阵X变为单位矩阵。同时,我们也把这个相应的矩阵操作运用在右侧。这样当左侧变为单位矩阵之后,那么右侧的矩阵就是原始矩阵\(X\)的逆矩阵\(X^{-1}\),具体证明如下:

\(\[X | I\]\)- \(\[X^{-1}X | X^{-1}I\]\)- \(\[I | X^{-1}I\]\)- \(\[I | X^{-1}\]\)

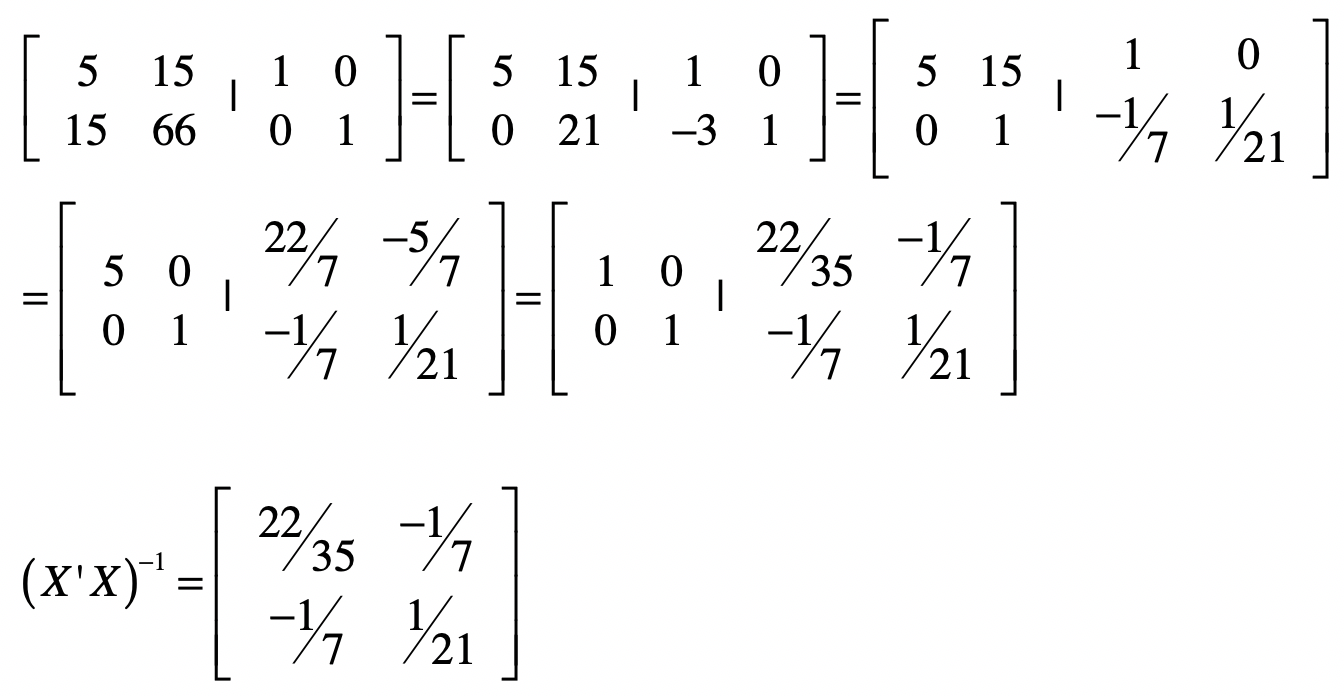

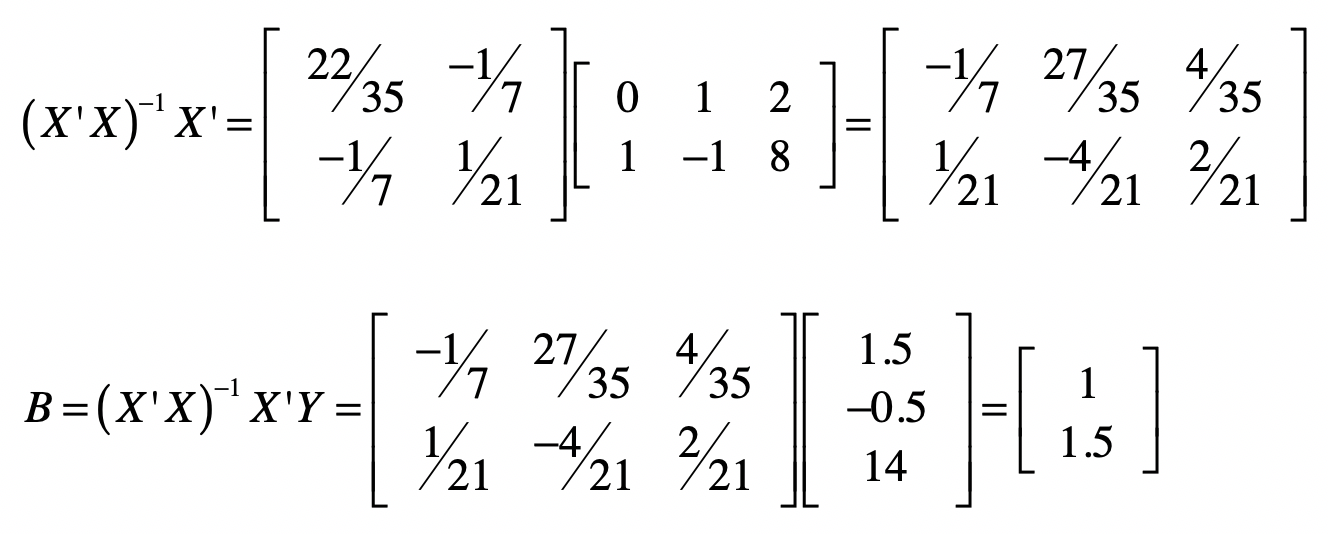

好了,给定下面的\(X’X\)矩阵之后,我们使用上述方法来求\((X’X)^{-1}\) 。我把具体的推导过程列在了这里。

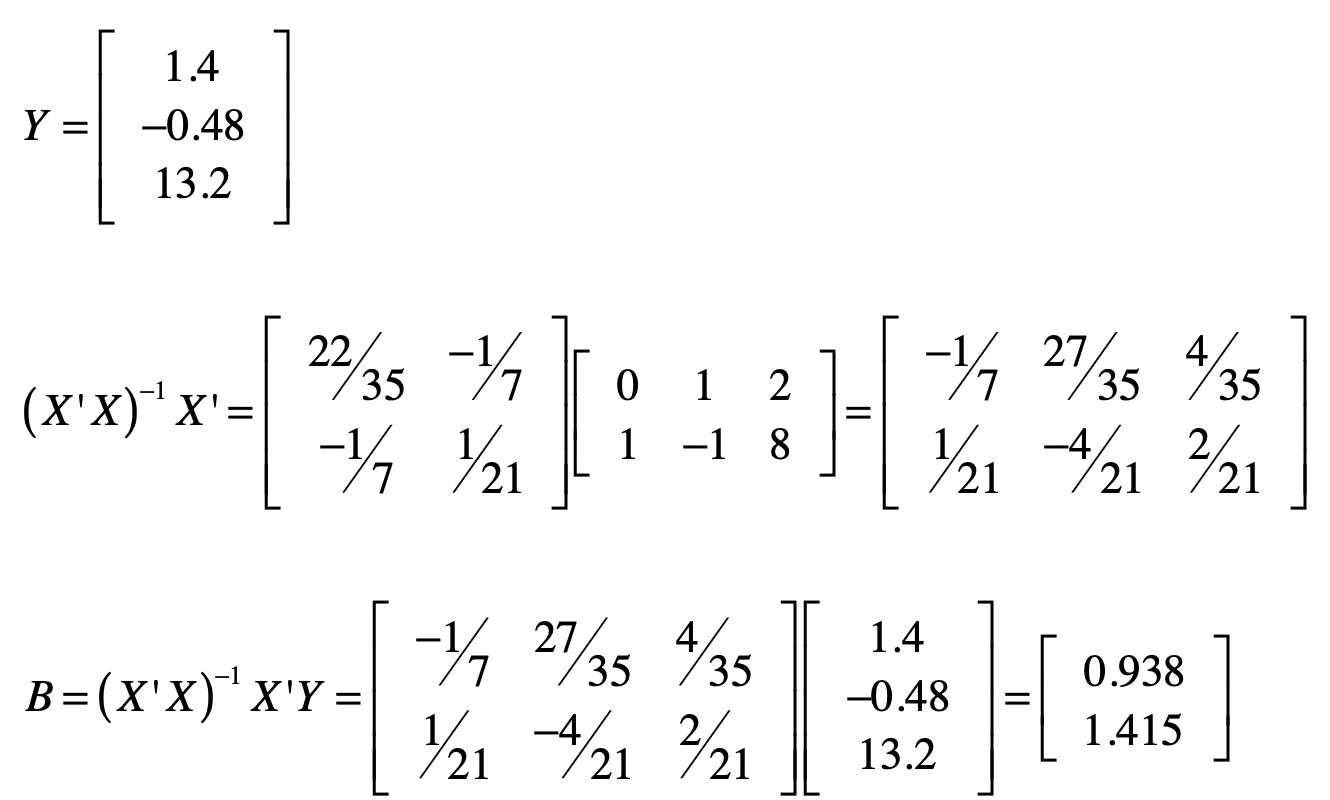

求出\((X’X)^{-1}\)之后,我们就可以使用\(B=(X’X)^{-1}X’Y\)来计算矩阵B。

最终,我们求出系数矩阵为\(\[1 1.5\]\),也就是说\(b\_1 = 1\), \(b\_2 = 1.5\)。实际上,这两个数值是精确解。我们用高斯消元也是能获得同样结果的。接下来,让我稍微修改一下\(y\)值,让这个方程组没有精确解。

\(b\_1·0+b\_2·1=1.4\)- \(b\_1·1-b\_2·1=-0.48\)- \(b\_1·2+b\_2·8=13.2\)

你可以尝试高斯消元法对这个方程组求解,你会发现只要两个方程就能求出解,但是无论是哪两个方程求出的解,都无法满足第三个方程。

那么通过最小二乘法,我们能不能求导一个近似解,保证_ε_足够小呢?下面,让我们遵循之前求解\((X’X)^{-1}X’Y\)的过程,来计算\(B\)。

计算完毕之后,你会发现两个系数的值分别变为\(b\_1 = 0.938, b\_2 = 1.415\)。由于这不是精确解,所以让我们看看有了这系数矩阵\(B\)之后,原有的观测数据中,真实值和预测值的差别。

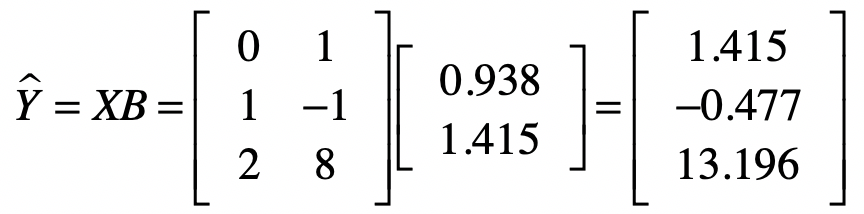

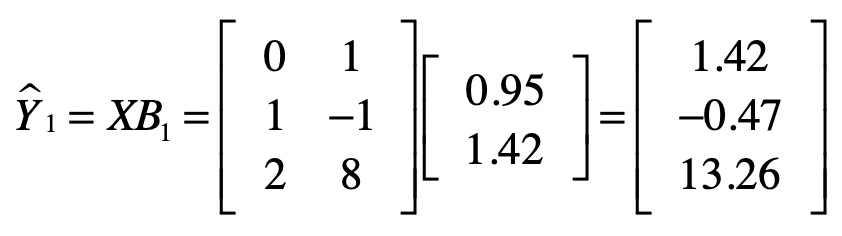

首先我们通过系数矩阵\(B\)和自变量矩阵\(X\)计算出来预测值。

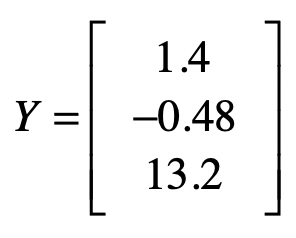

然后是样本数据中的观测值。这里我们假设这些值是真实值。

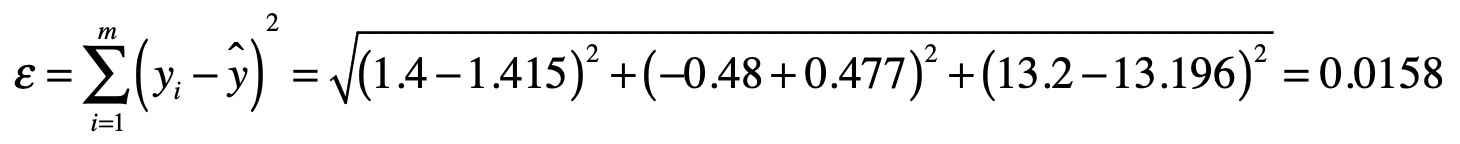

根据误差\(ε\)的定义,我们可以得到:

说到这里,你可能会怀疑,通过最小二乘法所求得的系数\(b\_1 = 0.949\)和\(b\_2 = 1.415\),是不是能让\(ε\)最小呢?这里,我们随机的修改一下这两个系数,变为\(b\_1 = 0.95\)和\(b\_2 = 1.42\),然后我们再次计算预测的\(y\)值和\(ε\)。

很明显,0.064是大于之前的0.0158。

这两次计算预测值_y_的过程,其实也是我们使用线性回归,对新的数据进行预测的过程。简短地总结一下,线性回归模型根据大量的训练样本,推算出系数矩阵\(B\),然后根据新数据的自变量\(X\)向量或者矩阵,计算出因变量的值,作为新数据的预测。

Python代码实现

这一部分,我们使用Python的代码,来验证一下之前的推算结果是不是正确,并看看最小二乘法和Python sklearn库中的线性回归,这两种结果的对比。

首先,我们使用Python numpy库中的矩阵操作来实现最小二乘法。主要的函数操作涉及矩阵的转置、点乘和求逆。具体的代码和注释我列在了下方。

from numpy import *

x = mat([[0,1],[1,-1],[2,8]])

y = mat([[1.4],[-0.48],[13.2]])

# 分别求出矩阵X'、X'X、(X'X)的逆

# 注意,这里的I表示逆矩阵而不是单位矩阵

print("X矩阵的转置X':\n", x.transpose())

print("\nX'点乘X:\n", x.transpose().dot(x))

print("\nX'X矩阵的逆\n", (x.transpose().dot(x)).I)

print("\nX'X矩阵的逆点乘X'\n", (x.transpose().dot(x)).I.dot(x.transpose()))

print("\n系数矩阵B:\n", (x.transpose().dot(x)).I.dot(x.transpose()).dot(y))

通过上述代码,你可以看到每一步的结果,以及最终的矩阵\(B\)。你可以把输出结果和之前手动推算的结果进行对比,看看是不是一致。

除此之外,我们还可把最小二乘法的线性拟合结果和sklearn库中的LinearRegression().fit()函数的结果相比较,具体的代码和注释我也放在了这里。

import pandas as pd

from sklearn.linear_model import LinearRegression

df = pd.read_csv("/Users/shenhuang/Data/test.csv")

df_features = df.drop(['y'], axis=1) #Dataframe中除了最后一列,其余列都是特征,或者说自变量

df_targets = df['y'] #Dataframe最后一列是目标变量,或者说因变量

print(df_features, df_targets)

regression = LinearRegression().fit(df_features, df_targets) #使用特征和目标数据,拟合线性回归模型

print(regression.score(df_features, df_targets)) #拟合程度的好坏

print(regression.intercept_)

print(regression.coef_) #各个特征所对应的系数

其中,test.csv文件的内容我也列在了这里。

\(x\_1,x\_2,y\)- \(0,1,1.4\)- \(1,-1,-0.48\)- \(2,8,13.2\)

这样写是为了方便我们使用pandas读取csv文件并加载为dataframe。

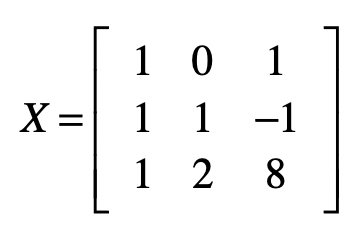

在最终的结果中,1.0表示拟合程度非常好,而-0.014545454545452863表示一个截距,[0.94909091 1.41454545]表示系数\(b\_1\)和\(b\_2\)的值。这个结果和我们最小二乘法的结果有所差别,主要原因是LinearRegression().fit()默认考虑了有线性函数存在截距的情况。那么我们使用最小二乘法是不是也可以考虑有截距的情况呢?答案是肯定的,不过我们首先要略微修改一下方程组和矩阵\(X\)。如果我们假设有截距存在,那么线性回归方程就要改写为:

\(b\_0+b\_1·x\_1+b\_2·x\_2+…+b\_{n-1}·x\_{n-1}+b\_n·x\_n=y\)

其中,\(b\_0\)表示截距,而我们这里的方程组用例就要改写为:

\(b\_0+b\_1·0+b\_2·1=1.4\)- \(b\_0+b\_1·1-b\_2·1=-0.48\)- \(b\_0+b\_1·2+b\_2·8=13.2\)

而矩阵\(X\)要改写为:

然后我们再执行下面这段代码。

from numpy import *

x = mat([[1,0,1],[1,1,-1],[1,2,8]])

y = mat([[1.4],[-0.48],[13.2]])

print("\n系数矩阵B:\n", (x.transpose().dot(x)).I.dot(x.transpose()).dot(y))

你就会得到:

系数矩阵B:

[[-0.01454545]

[ 0.94909091]

[ 1.41454545]]

这个结果和LinearRegression().fit()的结果就一致了。

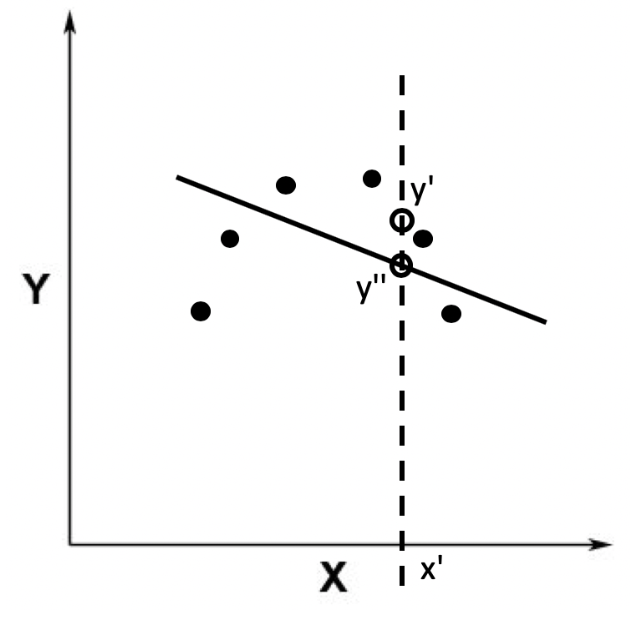

需要注意的是,使用线性回归的时候,我们都有一个前提假设,那就是数据的自变量和因变量之间呈现线性关系。如果不是线性关系,那么使用线性模型来拟合的效果一定不好。比如,之前在解释欠拟合的时候,我用过下面这个例子。

上面这张图的数据分布并没有表达线性关系,所以我们需要对原始的数据进行非线性的变换,或者是使用非线性的模型来拟合。

那么,我们如何判断一个数据集是不是能用线性模型表示呢?在线性回归中,我们可以使用决定系数R2。这个统计指标使用了回归平方和与总平方和之比,是反映模型拟合度的重要指标。它的取值在0到1之间,越接近于1表示拟合的程度越好、数据分布越接近线性关系。随着自变量个数的增加,R2将不断增大,因此我们还需要考虑方程所包含的自变量个数对R2的影响,这个时候可使用校正的决定系数Rc2。所以,在使用各种科学计算库进行线性回归时,你需要关注R2或者Rc2,来看看是不是一个好的线性拟合。在之前的代码实践中,我们提到的regression.score函数,其实就是返回了线性回归的R2。

总结

今天我们使用了具体的案例来推导最小二乘法的计算过程,并用Python代码进行了验证。通过最近3节的讲解,相信你对线性方程组求精确解、求近似解、以及如何在线性回归中运用这些方法,有了更加深入的理解。

实际上,从广义上来说,最小二乘法不仅可以用于线性回归,还可以用于非线性的回归。其主要思想还是要确保误差ε最小,但是由于现在的函数是非线性的,所以不能使用求多元方程求解的办法来得到参数估计值,而需要采用迭代的优化算法来求解,比如梯度下降法、随机梯度下降法和牛顿法。

思考题

我这里给出一个新的方程组,请通过最小二乘法推算出系数的近似解,并使用你熟悉的语言进行验证。

\(b\_1+b\_2·3+b\_3·(-7)=-7.5\)- \(b\_1·2+b\_2·5+b\_3·4=5.2\)- \(b\_1·(-3)+b\_2·(-7)+b\_3·(-2)=-7.5\)- \(b\_1·1+b\_2·4+b\_3·(-12)=-15\)

欢迎留言和我分享,也欢迎你在留言区写下今天的学习笔记。你可以点击“请朋友读”,把今天的内容分享给你的好友,和他一起精进。

© 2019 - 2023 Liangliang Lee. Powered by gin and hexo-theme-book.